ChatGPT, Copilot & Co. verwenden Large Language Models (LLMs). Diese werden auf leistungsstarken Servern ausgeführt und als Cloud-Services angeboten. Das funktioniert wunderbar. Aber nicht jeder will Daten, Text und Code ständig in die Cloud hochladen. Kann man also — mit »gewöhnlicher« Hardware — LLMs auch lokal ausführen?

Tatsächlich ist das verblüffend einfach. Das Tool der Wahl heißt Ollama. Was Docker für Container ist, ist Ollama für LLMs!

Ollama kann ziemlich mühelos unter Linux, macOS und Windows installiert werden. Unter Windows und macOS starten Sie Ollama als Hintergrunddienst mit einer winzigen grafischen Oberfläche (im Prinzip nur ein Icon, das den Status anzeigt). Unter Linux richten Sie den Dienst mit systemctl ein:

systemctl enable --now ollama

Ollama anwenden

Jetzt können Sie Ollama mit dem gleichnamigen Kommando im Terminal ausführen. Mit ollama run <llmname> installieren Sie eines der öffentlich verfügbaren Sprachmodelle (mehr dazu im nächsten Abschnitt) und können dann im Textmodus Kommandos ausführen:

ollama run llama2

>>> I need a regex to verify a date in US format. Can you help?

Of course! To match a date in the format of "MM/DD/YYYY" (month-day-year)

or "MM/DD/YYYY HH:MM AM/PM", you can use the following regular expression:

\b(\d{1,2}/\d{1,2}/\d{4})|(\d{1,2}/\d{1,2}/\d{4} \d{0,2})?\b

Here's a breakdown of how this regex works:

* \b: Matches a word boundary (the start or end of a word) to ensure

we're matching the entire date field.

* (\d{1,2}/\d{1,2}/\d{4}): Matches the month/day/year format. The

(\d{1,2}) captures the month and day as individual digits (0-2

digits for the month and 1-2 digits for the day). The / separates

the date components.

* |: Or, used to match the alternative format.

* (\d{1,2}/\d{1,2}/\d{4} \d{0,2})?: Matches the month/day/year with

time format. The (\d{1,2}) captures the month and day as individual

digits (0-2 digits for the month and 1-2 digits for the day). The /

separates the date components. The \d{0,2} matches the time component

(0-2 digits representing the hour and minute).

* \b: Matches a word boundary to ensure we're matching the entire date field again.

Note that this regex will match both US and international dates in the

"MM/DD/YYYY" format, as well as dates in the "MM/DD/YYYY HH:MM AM/PM"

format. If you need a more specific format (e.g., only US dates),

feel free to modify the regex accordingly.

Manche Sprachmodelle können auch Deutsch (nochmals llama2), wenngleich die sprachliche Qualität mitunter nur mittelmäßig ist.

>>> Was ist der Dopplereffekt?

Der Dopplereffekt ist ein physikalischer Effekt, der durch die Beugung von

Lichtwellen verursacht wird, wenn diese durch eine mediummässige Materie

passt. In einer bestimmten Umgebung oder Situation kann das Licht, das durch

eine bestimmte Fläche oder ein Objekt passt, sich "verlangsamen" und eine

Dopplereffekthelligkeit erzeugen.

Der Dopplereffekt ist ein spezifischer Effekt, der auf der Beugung von

Lichtwellen basiert. Wenn Licht durch ein Medium passt, wird es durch die Faser

des Mediums beugt und umgestaltet. Die Intensität des Lichts, das durch ein

Medium passt, kann sich durch den Dopplereffekt ändern.

Im Alltag können wir den Dopplereffekt beispielsweise bei der Anähnlichkeit von

Objekten in einer Ferne sehen. Wenn ein Auto oder eine andere Objekte in der

Ferne auf uns zukommt, wird es durch die Luft des Raumes beugt und erscheint

größer und weiter weg, als es tatsächlich ist.

Der Dopplereffekt kann auch in anderen Bereichen wie der Optik, Elektrotechnik

oder Medizin verwendet werden. Zum Beispiel können Dopplereffekte in der

Medizin verwendet werden, um die Blutungen in einem Körperteil zu bestimmen.

Es gibt verschiedene Arten von Dopplereffekten, darunter:

* LichtDopplereffekt: Der Effekt, den das Licht erzeugt, wenn es durch ein

Medium passt.

* ZeitDopplereffekt: Der Effekt, den die Zeit erzeugt, wenn sie durch ein

Objekt oder eine bestimmte Umgebung verändert wird.

* Räumliche Dopplereffekte: Der Effekt, den die räumliche Position von Objekten

oder der Standort eines Beobachters auf die Erscheinung des Dopplereffekts

ausübt.

Insgesamt ist der Dopplereffekt ein interessanter und wichtiger

physikalischerEffekt, der in vielen Bereichen der Wissenschaft und Technologie

Verwendung findet.

Ollama stellt seine Funktionen über eine REST-API zur Verfügung und kann somit lokal auch durch eigene Scripts und Editor-Plugins (z.B. Continue für VSCode) genutzt werden. Natürlich gibt es auch Module/Bibliotheken für diverse Sprachen, z.B. für Python.

Öffentliche Sprachmodelle

Die bekanntesten Sprachmodelle sind zur Zeit GPT-3.5 und GPT-4. Sie wurden von der Firma openAI entwickelt und sind die Basis für ChatGPT. Leider sind die aktellen GPT-Versionen nicht öffentlich erhältlich.

Zum Glück gibt es aber eine Menge anderer Sprachmodelle, die wie Open-Source-Software kostenlos heruntergeladen und von Ollama ausgeführt werden können. Gut geeignet für erste Experimente sind llama2, gemma und mistral. Einen Überblick über wichtige, Ollama-kompatible LLMs finden Sie hier:

Noch viel mehr LLMs finden Sie auf HuggingFace, einer öffentlichen Plattform für KI-Forscher und -Anwender:

Viele Sprachmodelle stehen in unterschiedlicher Größe zur Verfügung. Die Größe wird in der Anzahl der Parameter gemessen (7b = 7 billions = 7 Milliarden). Die Formel »größer ist besser« gilt dabei nur mit Einschränkungen. Mehr Parameter versprechen eine bessere Qualität, das Modell ist dann aber langsamer in der Ausführung und braucht mehr Platz im Arbeitsspeicher. Die folgende Tabelle gilt für llama2, einem frei verfügbaren Sprachmodell der Firma Meta (Facebook & Co.).

Name. Parameter Größe

---------- ---------- --------

llama2 7 Mrd. 4 GB

llama2:13b 13 Mrd. 7 GB

llama2:70b 70 Mrd. 39 GB

Wenn Sie llama2:70b ausführen wollen, sollte Ihr Rechner über 64 GB RAM verfügen.

Update: Quasi zugleich mit diesem Artikel wurde llama3 fertiggestellt (Details und noch mehr Details). Aktuell gibt es zwei Größen, 8b (5 GB) und 80b (40 GB).

Bildverarbeitung

Ollama kann aber auch KI-Modelle zur Bildverarbeitung ausführen, z.B. LLaVA (siehe https://ollama.com/blog/vision-models).

ollama run llava:13b

>>> describe this image: raspap3.jpg

Added image 'raspap3.jpg'

The image shows a small, single-board computer like the Raspberry Pi 3, which is

known for its versatility and uses in various projects. It appears to be connected

to an external device via what looks like a USB cable with a small, rectangular

module on the end, possibly an adapter or expansion board. This connection

suggests that the device might be used for communication purposes, such as

connecting it to a network using an antenna. The antenna is visible in the

upper part of the image and is connected to the single-board computer by a

cable, indicating that this setup could be used for Wi-Fi or other wireless

connectivity.

The environment seems to be an indoor setting with wooden flooring, providing a

simple and clean background for the electronic components. There's also a label

on the antenna, though it's not clear enough to read in this image. The setup

is likely part of an electronics project or demonstration, given the simplicity

and focus on the connectivity equipment rather than any additional peripherals

or complex arrangements.

Eigentlich eine ganz passable Beschreibung für das folgende Bild!

Praktische Erfahrungen, Qualität

Es ist erstaunlich, wie rasch die Qualität kommerzieller KI-Tools — gerade noch als IT-Wunder gefeiert — zur Selbstverständlichkeit wird. Lokale LLMs funktionieren auch gut, können aber in vielerlei Hinsicht (noch) nicht mit den kommerziellen Modellen mithalten. Dafür gibt es mehrere Gründe:

- Bei kommerziellen Modellen fließt mehr Geld und Mühe in das Fine-Tuning.

-

Auch das Budget für das Trainingsmaterial ist größer.

-

Kommerzielle Modelle sind oft größer und laufen auf besserer Hardware. Das eigene Notebook ist mit der Ausführung (ganz) großer Sprachmodelle überfordert. (Siehe auch den folgenden Abschnitt.)

Wodurch zeichnet sich die geringere Qualität im Vergleich zu ChatGPT oder Copilot aus?

- Die Antworten sind weniger schlüssig und sprachlich nicht so ausgefeilt.

-

Wenn Sie LLMs zum Coding verwenden, passt der produzierte Code oft weniger gut zur Fragestellung.

-

Die Antworten werden je nach Hardware viel langsamer generiert. Der Rechner läuft dabei heiß.

-

Die meisten von mir getesteten Modelle funktionieren nur dann zufriedenstellend, wenn ich in englischer Sprache mit ihnen kommuniziere.

Die optimale Hardware für Ollama

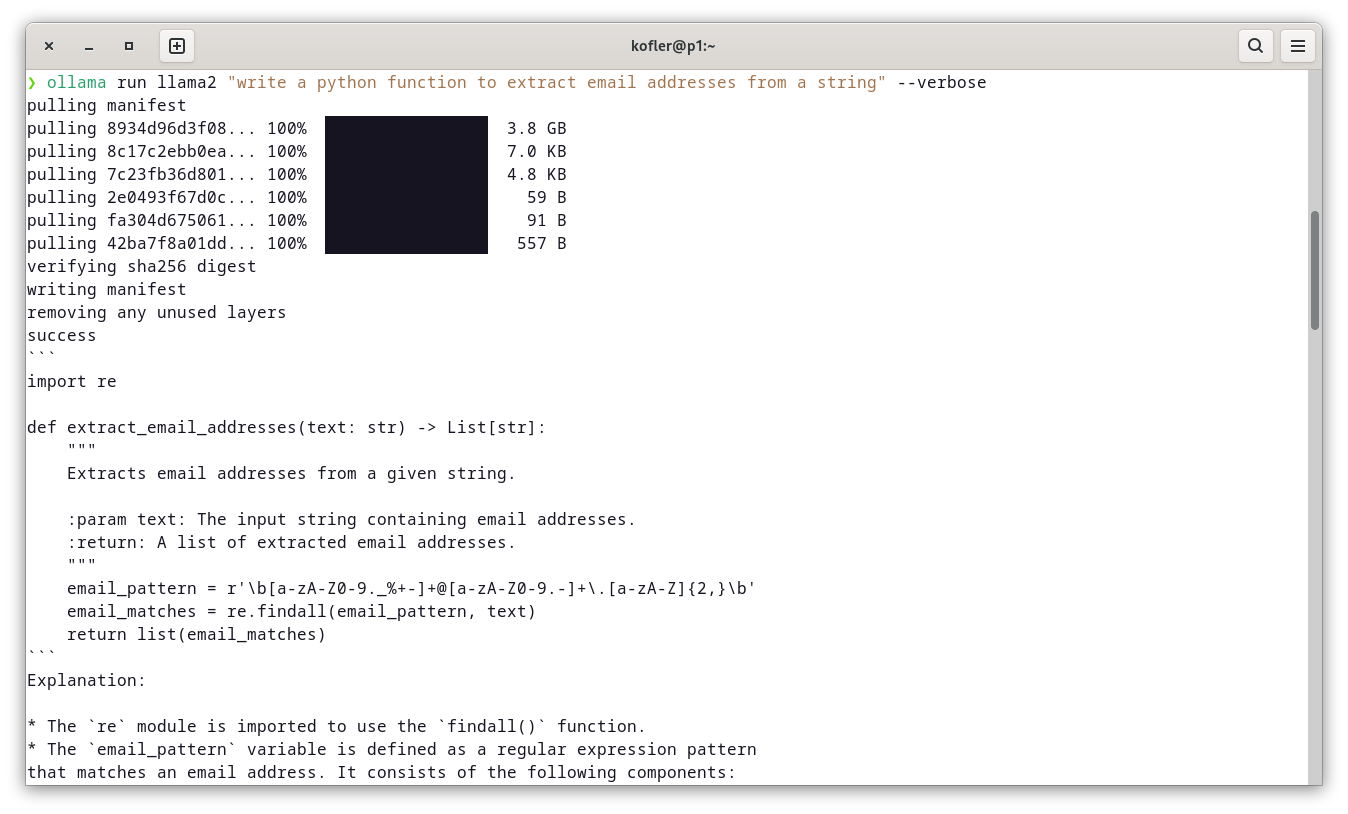

Als Minimal-Benchmark haben Bernd Öggl und ich das folgende Ollama-Kommando auf diversen Rechnern ausgeführt:

ollama run llama2 "write a python function to extract email addresses from a string" --verbose

Die Ergebnisse dieses Kommandos sehen immer ziemlich ähnlich aus, aber die erforderliche Wartezeit variiert beträchtlich!

Update: Grafische Darstellung der Geschwindigkeit unter https://kofler.info/mini-benchmark-fuer-die-ausfuehrung-lokaler-sprachmodelle/

Lenovo T16, Linux. 12th Gen Intel i5-1250P cores=12, 32 GiB RAM, Alder Lake-P Integrated Graphics Controller

total duration: 4m7.981004535s

load duration: 979.201µs

prompt eval count: 31 token(s)

prompt eval duration: 3.061771s

prompt eval rate: 10.12 tokens/s

eval count: 478 token(s)

eval duration: 4m4.913456s

eval rate: 1.95 tokens/s

Lenovo P1 (2018), Linux. Intel i8750H 6 cores / 12 threads, 32 GiB RAM, NVIDIA Quadro P1000

Die GPU wurde nicht genutzt.

total duration: 1m48.168754835s

load duration: 204.369µs

prompt eval duration: 146.12ms

prompt eval rate: 0.00 tokens/s

eval count: 629 token(s)

eval duration: 1m48.021933s

eval rate: 5.82 tokens/s

MacBook Air 2020, M1, 8GiB RAM

total duration: 52.303529042s

load duration: 4.741221334s

prompt eval count: 31 token(s)

prompt eval duration: 331.908ms

prompt eval rate: 93.40 tokens/s

eval count: 567 token(s)

eval duration: 47.211456s

eval rate: 12.01 tokens/s

MacBook Air M2 2023, 24 GB

total duration: 35.853232792s

load duration: 5.297790333s

prompt eval count: 32 token(s)

prompt eval duration: 211.272ms

prompt eval rate: 151.46 tokens/s

eval count: 617 token(s)

eval duration: 30.343375s

eval rate: 20.33 tokens/s

MacBook Pro M3 Pro 2023, 36 GB

total duration: 28.392226667s

load duration: 5.532561667s

prompt eval count: 31 token(s)

prompt eval duration: 119.313ms

prompt eval rate: 259.82 tokens/s

eval count: 667 token(s)

eval duration: 22.740198s

eval rate: 29.33 tokens/s

Bzw. mit llama3:8b: 26,6 tokens/s.

Windows PC i7 64GB RAM + Nvidia 3070

total duration: 12.9912206s

load duration: 5.2628606s

prompt eval count: 31 token(s)

prompt eval duration: 83.136ms

prompt eval rate: 372.88 tokens/s

eval count: 514 token(s)

eval duration: 7.644094s

eval rate: 67.24 tokens/s

Linux PC, AMD Ryzen 5 7600 64 GB RAM + Nvidia RTX3090 mit 24 GB RAM

(mit llama3)

total duration: 5.008054596s

load duration: 899.374µs

prompt eval duration: 17.275ms

prompt eval rate: 0.00 tokens/s

eval count: 473 token(s)

eval duration: 4.948306s

eval rate: 95.59 tokens/s

Grundsätzlich kann Ollama GPUs nutzen (siehe auch hier und hier). Im Detail hängt es wie immer vom spezifischen GPU-Modell, von den installierten Treibern usw. ab. Wenn Sie unter Linux mit einer NVIDIA-Grafikkarte arbeiten, müssen Sie CUDA-Treiber installieren und ollama-cuda ausführen. Beachten Sie auch, dass das Sprachmodell im Speicher der Grafikkarte Platz finden muss, damit die GPU genutzt werden kann.

Apple-Rechner mit M1/M2/M3-CPUs sind für Ollama aus zweierlei Gründen ideal: Es gibt keinen Ärger mit Treibern, und der gemeinsame Speicher für CPU/GPU ist vorteilhaft. Die GPUs verfügen über so viel RAM wie der Rechner. Außerdem bleibt der Rechner lautlos, wenn Sie Ollama nicht ununterbrochen mit neuen Abfragen beschäftigen. Allerdings verlangt Apple leider vollkommen absurde Preise für RAM-Erweiterungen.

Zum Schluss noch eine Bitte: Falls Sie Ollama auf Ihrem Rechner installiert haben, posten Sie bitte Ihre Ergebnisse des Kommandos ollama run llama2 "write a python function to extract email addresses from a string" --verbose im Forum!

Quellen/Links

- https://ollama.com

- https://github.com/ollama/ollama

- https://github.com/ollama/ollama-python

- https://continue.dev/docs/intro

- https://ollama.com/library

- https://huggingface.co/models

- https://ollama.com/blog/llama3

- https://huggingface.co/meta-llama/Meta-Llama-3-70B-Instruct

- https://ollama.com/blog/vision-models

- https://llama.meta.com

- https://llava-vl.github.io

- https://github.com/ollama/ollama/blob/main/docs/gpu.md

- https://github.com/ollama/ollama/issues/1651

Weitere Links zum Thema GPU/NPU-Nutzung:

Hallo Herr Kofler,

interessant finde ich, dass die ältere CPU –> Intel i8750H 6 cores um 2 Minuten schneller ist als die neuere CPU –> Intel i5-1250P cores=12. Haben Sie da eine Erklärung?

Keine Ahnung. Laut Spezifikationen müsste die 1250P eigentlich ein wenig schneller sein.

Hallo,

mit einem MacBoo M3 Pro mit 18 GB RAM ergibt sich folgendes:

total duration: 22.576753125s

load duration: 4.390029375s

prompt eval count: 31 token(s)

prompt eval duration: 113.382ms

prompt eval rate: 273.41 tokens/s

eval count: 523 token(s)

eval duration: 18.071776s

eval rate: 28.94 tokens/s

Grüße

Bernhard

Hi,

kannst Du bitte Audiobeispiele hochladen, damit wir eine genaue Vorstellung der Qualität haben?

Vielen Dank

von Audio habe ich doch gar nichts geschrieben (und auch nichts getestet)

Hallo,

auf einem Macbook Pro 2017 (Dual-Core Intel Core i5), 8 GB RAM erhalte ich folgende Werte:

total duration: 3m20.936081979s

load duration: 25.21670753s

prompt eval count: 31 token(s)

prompt eval duration: 12.50191s

prompt eval rate: 2.48 tokens/s

eval count: 564 token(s)

eval duration: 2m43.204475s

eval rate: 3.46 tokens/s

Danke und viele Grüße

Michael

Ryzen 5 3400G / 16GB RAM:

total duration: 1m50.474311561s

load duration: 821.037µs

prompt eval count: 31 token(s)

prompt eval duration: 4.780372s

prompt eval rate: 6.48 tokens/s

eval count: 542 token(s)

eval duration: 1m45.650891s

eval rate: 5.13 tokens/s

Intel i5 13500/64 GB RAM, keine Grafikkarte

Ubuntu 22.04

total duration: 52.933547971s

load duration: 1.018398ms

prompt eval count: 31 token(s)

prompt eval duration: 4.47907s

prompt eval rate: 6.92 tokens/s

eval count: 483 token(s)

eval duration: 48.411602s

eval rate: 9.98 tokens/s

Windows Laptop AMD Ryzen 5800H mit 32 GB RAM und mit Nvidia RTX 3070 Laptop GPU und 8 GB Speicher (bis 140 Watt) am Strom und maximale Leistung:

total duration: 8.5404086s

load duration: 1.6041ms

prompt eval count: 14 token(s)

prompt eval duration: 356.53ms

prompt eval rate: 39.27 tokens/s

eval count: 525 token(s)

eval duration: 8.18142s

eval rate: 64.17 tokens/s

Windows Laptop AMD Ryzen 5800H mit 32 GB RAM und mit Nvidia RTX 3070 Laptop GPU und 8 GB Speicher (bis x Watt) am Akku und leise Profil:

total duration: 3m49.5294427s

load duration: 9.1745992s

prompt eval count: 31 token(s)

prompt eval duration: 2.171237s

prompt eval rate: 14.28 tokens/s

eval count: 753 token(s)

eval duration: 3m38.17982s

eval rate: 3.45 tokens/s

Weitere Benchmarks in der Arbeitsumgebung:

Linux-Laptop AMD Ryzen 7 Pro 5850U mit 48 GB RAM

total duration: 1m30.54535302s

load duration: 931.54µs

prompt eval count: 31 token(s)

prompt eval duration: 2.144222s

prompt eval rate: 14.46 tokens/s

eval count: 583 token(s)

eval duration: 1m28.354217s

eval rate: 6.60 tokens/s

HPC Linux mit Intel Xeon Platinum 8368 2xSockets (=76 cores) und 256 GB RAM

total duration: 20.6078927s

load duration: 1.253133ms

prompt eval count: 31 token(s)

prompt eval duration: 362.487ms

prompt eval rate: 85.52 tokens/s

eval count: 414 token(s)

eval duration: 20.201774s

eval rate: 20.49 tokens/s

HPC Linux mit Intel Xeon Platinum 8368 2xSockets (=76 cores) und 512 GB RAM plus 1xNVIDIA A100-40 mit 40 GB

total duration: 9.548443027s

load duration: 5.361615825s

prompt eval count: 31 token(s)

prompt eval duration: 114.505ms

prompt eval rate: 270.73 tokens/s

eval count: 534 token(s)

eval duration: 4.030479s

eval rate: 132.49 tokens/s

Vielen Dank für alle Antworten! Siehe auch die grafische Darstellung der wichtigsten Ergebnisse unter https://kofler.info/mini-benchmark-fuer-die-ausfuehrung-lokaler-sprachmodelle/!

Hallo Michael

noch ein Ergebnis, aber mit llama3:

total duration: 47.462209614s

load duration: 3.252125484s

prompt eval count: 21 token(s)

prompt eval duration: 782.996ms

prompt eval rate: 26.82 tokens/s

eval count: 437 token(s)

eval duration: 43.385849s

eval rate: 10.07 tokens/s

System:

Kernel: 6.8.9-zen1-2-zen arch: x86_64 bits: 64 compiler: gcc v: 14.1.1

Machine:

Mobo: ASRock model: B650M-HDV/M.2

Memory:

System RAM: total: 32 GiB available: 30.47 GiB used: 4.44 GiB (14.6%)

Array-1: capacity: 128 GiB slots: 2 modules: 2 EC: None

max-module-size: 64 GiB note: est.

Device-1: Channel-A DIMM 0 type: DDR5 size: 16 GiB speed: spec: 4800 MT/s

actual: 6000 MT/s

Device-2: Channel-B DIMM 0 type: DDR5 size: 16 GiB speed: spec: 4800 MT/s

actual: 6000 MT/s

CPU:

Info: 6-core model: AMD Ryzen 5 7600 bits: 64 type: MT MCP arch: Zen 4 rev: 2 cache: L1: 384 KiB L2: 6 MiB L3: 32 MiB

Graphics:

Device-1: AMD Navi 22 [Radeon6700 XT]

vendor: Tul / PowerColor driver: amdgpu v: kernel arch: RDNA-2

bus-ID: 03:00.0

Device-2: AMD Raphael driver: amdgpu v: kernel arch: RDNA-2

bus-ID: 0f:00.0 temp: 52.0 C

Die GPU wird leider aktuell knapp nicht supported, daher wohl der große Unterschied zum anderen System mit Ryzen 5 7600.